Nay Toyota mù quáng “bắt chước”?

Cách đây một thời gian, Elon Musk đã bày tỏ quan điểm rằng nếu như con người chỉ cần dùng mắt là có thể lái được xe thì các mẫu xe tự hành cũng chỉ cần có vậy – một hệ thống camera đủ mạnh.

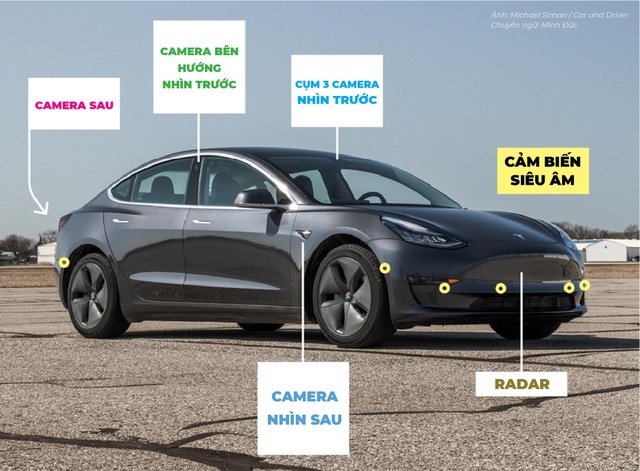

Vì quan điểm này mà các mẫu xe của Tesla ngày nay đã được loại bỏ cảm biến RADAR hướng trước, các mẫu xe đời cũ thì được cập nhật phần mềm để máy tính trên xe phớt lờ bộ phận này. Hầu hết các chuyên gia nghiên cứu phát triển công nghệ tự hành đều phản đối quan điểm này của Elon Musk.

Tuy nhiên, mới đây thì Woven Planet (phân nhánh nghiên cứu công nghệ tự lái của Toyota) lại cho rằng cách làm của Elon Musk có thể dẫn tới thành công.

Vị trí các cảm biến trên Tesla Model 3. Ảnh: Michael Simari / Car and Driver. Chuyển ngữ: Minh Đức

Lý do giải thích cho việc này có thể nhắc tới việc Toyota vẫn sẽ triển khai hệ thống robotaxi với đầy đủ các thể loại cảm biến và nhiều phương tiện khác trên đường phố công cộng. Woven Planet cho rằng với lượng xe đông đảo này, họ có thể thu thập được nhiều dữ liệu từ các mẫu xe này chỉ với hệ thống camera. Vì so với giá thành các cảm biến khác, camera rẻ hơn nhiều, có thể dễ dàng trang bị thêm.

Đối với các công ty nghiên cứu hệ thống tự lái, dữ liệu thực có thể ví với nước uống của con người – là nguồn tài nguyên không thể thiếu. Thật vậy, phó chủ tịch phụ trách vấn đề kỹ thuật của Woven Planet, ông Michael Benisch, cho biết rằng: “Chúng tôi cần rất nhiều dữ liệu. Nếu dữ liệu có từ một số lượng nhỏ xe chạy trên đường thì nhiêu đó là chưa đủ.”

Xe thử nghiệm công nghệ tự lái của VinAI (trực thuộc Vingroup) sử dụng cảm biến LiDAR.

Ông Michael Benisch cho biết thêm rằng loại camera mà Woven Planet sử dụng hiệu quả hơn về mặt chi phí tới 90% so với sử dụng RADAR hoặc LiDAR mà đa phần các hãng khác đang sử dụng. Ý tưởng là họ có thể trang bị loại camera phù hợp lên số lượng xe hiện tại.

Sử dụng dữ liệu từ những camera này được xem là mang về nhiều dữ liệu hơn, trong thời gian nhanh hơn. Hệ quả từ việc này là hệ thống trí tuệ nhân tạo đằng sau công nghệ tự lái sau này chỉ cần dựa vào dữ liệu từ RADAR khi dữ liệu nguồn thu về cũng đều từ camera.

Đã không ít lần chủ xe Tesla kích hoạt chế độ tự lái và gặp tai nạn.

Trên thực tế thì cách làm mà Tesla đã tiên phong này nhận được rất nhiều chỉ trích, chủ yếu về việc camera chưa thực sự là một giải pháp tốt. Thông thường, nếu như dữ liệu từ camera không tốt, khiến việc phân tích gặp khó thì các kỹ sư sẽ cài đặt để hệ thống máy tính trên xe sử dụng dữ liệu từ các cảm biến khác để có thể đưa ra quyết định, giả sử khi nào thì đánh lái, khi nào thì phanh và phanh ở mức độ nào.

Gần đây, nhiều người dùng của Tesla đã phản ánh về hiện tượng phanh ảo khi họ kích hoạt chế độ tự lái chỉ dùng camera của hãng. Nhiều phán đoán cũng cho rằng nguồn gốc của sự việc đến từ việc Tesla chỉ dùng camera.

Chuyên gia Phil Koopman tại Đại học Carnegie Mellon, người nghiên cứu về an toàn của phương tiện tự hành, chia sẻ rằng: “Phanh ảo xảy ra khi người lập trình hệ thống không cài đặt tốt hành động của xe khi xác định có vật cản hoặc khi thông tin đầu vào không chính xác. Các nhà sản xuất khác thường sử dụng nhiều loại cảm biến, và những cảm biến này tự bù trừ cho nhau.”

Tuy nhiên, ông Michael Benisch tại Woven Planet thì vẫn một mực tin rằng tới một lúc nào đó trong tương lai, camera sẽ đủ tốt để chúng ta dựa vào nó mà không cần các cảm biến khác.

Ông bổ sung: “Trong nhiều, nhiều năm nữa, công nghệ tự lái sử dụng dữ liệu thuần từ camera hoàn toàn có thể phát triển ngang và vượt các cảm biến khác. Câu hỏi sẽ chỉ còn là khi nào và cần bao lâu để camera có thể đạt tới mức độ an toàn và tin cậy. Tôi thực ra cũng chưa biết câu trả lời”.

Nguồn : Source link